¿Cómo desindexar una o varias URLs de Google?

En la gestión técnica de un sitio web, gobernar el índice de Google es tan crucial como posicionar nuevas páginas. La desindexación estratégica permite purgar de las SERPs aquellas URLs que no aportan valor, consumen Crawl Budget o exponen información confidencial.

A continuación, se detalla una guía técnica con metodologías y herramientas oficiales para ejecutar la retirada de URLs de forma segura y eficiente.

Antes de tocar nada: cuándo sí y cuándo no desindexar

Antes de ejecutar acciones restrictivas, es imperativo diagnosticar si la URL requiere desindexación o una optimización alternativa.

Escenarios justificados para desindexar:

- Exposición de datos sensibles (información personal, entornos de staging, URLs de pruebas).

- Contenido obsoleto, duplicado o Thin Content carente de valor (filtros de navegación faceteada, URLs parametrizadas, etiquetas vacías).

- Migración de contenido a una nueva estructura donde no se desea la coexistencia de duplicados en el índice.

Escenarios donde aplicar alternativas:

- Si la página aporta valor pero sufre de bajo rendimiento: priorizar la optimización del contenido y del SEO On-Page antes de eliminarla.

- Si el objetivo es canalizar tráfico y traspasar autoridad: implementar una redirección 301 hacia la URL equivalente.

- Para resolver cuasi-duplicados: emplear la etiqueta Canonical apuntando a la versión principal para consolidar señales sin forzar una desaparición abrupta.

Nota técnica: Desindexar no es sinónimo de bloquear el rastreo. Para que Google elimine una URL, el Googlebot necesita rastrearla de nuevo para leer la directiva técnica (noindex, 410, 301) o procesar una solicitud manual en GSC.

Método 1: Retirada temporal en Google Search Console (paso a paso + límites)

La herramienta de “Retirada de URLs” en Google Search Console (GSC) es el mecanismo de respuesta a incidentes más ágil para ocultar resultados de las SERPs mientras se implementan soluciones a nivel de servidor o código.

Flujo de ejecución:

- Acceder a GSC y navegar al panel Índice > Retiradas.

- Seleccionar “Nueva solicitud” e introducir la URL exacta o el prefijo del patrón.

- Elegir la acción requerida:

- Quitar URL temporalmente: Oculta el resultado en las SERPs por un periodo aproximado de 6 meses.

- Borrar caché: Útil para purgar snippets antiguos tras haber modificado contenido sensible.

- Enviar la solicitud y monitorizar el estado en el panel de control.

Advertencia: Esta medida es estrictamente temporal. Si no se consolida con una directiva de servidor (410, 301) o metaetiqueta (noindex), la URL volverá a indexarse.

Método 2: Noindex (meta y X-Robots-Tag): implementación segura

El uso de la directiva noindex es el estándar de la industria para solicitar de manera “limpia” la exclusión de una página de los motores de búsqueda.

Opción A — Meta Robots (HTML) Inserción directa en el <head> del documento HTML. Es la solución óptima para páginas web convencionales (WordPress, Shopify, etc.): <meta name=”robots” content=”noindex, nofollow”>

Opción B — X-Robots-Tag (cabecera HTTP) Imprescindible para desindexar recursos que no procesan HTML, como archivos PDF, imágenes o patrones masivos gestionados desde el servidor.

- En servidor Apache (.htaccess): <FilesMatch “\.(html|php)$”> Header set X-Robots-Tag “noindex, nofollow” </FilesMatch>

- En servidor Nginx: location ~* \.(html|php)$ { add_header X-Robots-Tag “noindex, nofollow”; }

Buenas prácticas

- Nunca bloquees el acceso a la URL en el archivo robots.txt simultáneamente; Google necesita acceder a la ruta para poder leer la directiva noindex.

- Purgar el enlazado interno (interlinking) hacia dicha URL acelerará la caída de relevancia.

- Mantener la URL en un Sitemap temporalmente fuerza al bot a reevaluar la URL para descubrir la nueva directiva.

Método 3: 404 vs 410 vs 301 — cuál elegir en cada caso

Asignar el código de estado HTTP (Status Code) correcto resulta fundamental para acelerar la purga en el índice.

- Señal 410 (Gone) – Para páginas eliminadas definitivamente:

- Caso de uso: Contenido expirado que no volverá.

- Pros: Es una señal concluyente para el crawler, provocando una desindexación mucho más ágil que un 404 convencional.

- Contras: Revertirlo requiere esfuerzo; si el contenido regresa, la reindexación será lenta.

- Señal 404 (Not Found) – Eliminaciones genéricas:

- Caso de uso: Borrados estándar o de naturaleza temporal.

- Pros: Alta facilidad de implementación en cualquier CMS.

- Contras: El algoritmo es más conservador con los 404 y tarda más en purgar la URL de las SERPs.

- Señal 301 (Moved Permanently) – URL sustituida:

- Caso de uso: Migraciones de arquitectura, renombrado de slugs o fusiones de contenido.

- Pros: Preserva y transfiere histórico, tráfico y Link Juice (PageRank).

- Contras: La URL original puede demorar su desaparición visual de las SERPs durante la transición.

- Directiva Noindex (con Status 200 OK) – URLs vivas pero ocultas al índice:

- Caso de uso: URLs de filtros, motores de búsqueda internos, o áreas privadas.

- Pros: Ofrece un control de indexación granular sin afectar a la navegación o UX del usuario.

- Contras: Consume Crawl Budget, ya que requiere rastreo periódico.

Método 4: Contenido privado/staging: noindex + autenticación (sin fugas)

Los entornos de preproducción (Staging) son focos comunes de fugas de indexación. El protocolo de seguridad estándar obliga a emplear:

- Autenticación en servidor: Mediante Basic Auth o restricción por IP para denegar el acceso público.

- Directiva noindex global: Como capa de redundancia frente a posibles brechas.

- Disallow en robots.txt: Válido solo en entornos de pruebas puros y seguros para optimizar rastreo. Jamás publicar un entorno de staging sin autenticación.

Robots.txt no es desindexación: úsalo bien sin romper nada

Un error crítico en SEO es utilizar la directiva Disallow del archivo robots.txt para desindexar contenido. Este archivo restringe el rastreo, no el índice.

- Mala praxis (Bloqueo prematuro): Si una URL ya se encuentra indexada y añades un Disallow hacia esa ruta, Google no podrá rastrearla para leer un eventual noindex. El resultado: la URL seguirá apareciendo en las SERPs (usualmente sin metadescripción).

- Práctica correcta: Implementar primero noindex / 410 / 301. Permitir que Googlebot procese el cambio y depure la SERP. Solo una vez desindexada, considerar el bloqueo por Disallow para recuperar y salvaguardar Crawl Budget.

Cómo acelerar el proceso: recrawl, sitemaps, enlaces y señales

Para mitigar los tiempos de latencia del motor de búsqueda:

- Utilizar la herramienta de “Inspección de URL” en GSC y solicitar la indexación para forzar un re-rastreo inmediato.

- Eliminar todo el enlazado interno (menús de navegación, breadcrumbs, listados de categorías).

- Auditar y redirigir backlinks externos apuntando a las páginas eliminadas.

- Erradicar los Soft 404 (URLs vacías que devuelven un código 200 OK). Forzar un 410 o 404 real a nivel de cabecera HTTP.

Errores comunes que te están retrasando la desindexación

- Depender exclusivamente de la directiva Disallow en un archivo robots.txt sobre URLs previamente indexadas.

- Retirar la etiqueta noindex prematuramente antes de que Google purgue la SERP por completo.

- Generar cadenas de redirecciones (ej. 301 → 301 → 301) que diluyen la autoridad y el rastreo.

- Dejar URLs huérfanas antes de asentar un estado 301/410, dilatando el tiempo de descubrimiento del bot.

- No auditar la canibalización técnica por mayúsculas, trailing slashes (/), HTTP/HTTPS o parámetros dinámicos no controlados.

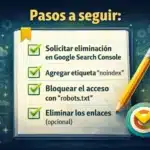

Checklist de verificación y seguimiento (qué mirar en GSC)

La confirmación del éxito de la desindexación debe auditarse con datos empíricos:

- Informe de Páginas (Cobertura): Validar la migración de URLs a estados “Excluida” o “No encontrada (404)”.

- Inspección de URL: Revisar la fecha de última lectura de Google y las directivas detectadas.

- Métricas de Rendimiento: Confirmar una caída a cero en las curvas de Impresiones y Clics.

- Logs del Servidor: Cruzar el análisis de los archivos log (peticiones de Googlebot) para confirmar que las respuestas HTTP emitidas son las correctas.

Preguntas frecuentes

¿Cuánto tarda Google en desindexar una URL? La horquilla temporal varía desde horas hasta semanas. Factores determinantes son la frecuencia de rastreo asignada al dominio y la contundencia del código de estado (un 410 fuerza la depuración notablemente más rápido que una directiva noindex sobre código 200).

¿La retirada de GSC es permanente? No, es una acción efímera (válida por aproximadamente 180 días). Debe estar siempre acompañada por una acción correctiva de servidor (301/410) o de marcado HTML (noindex).

¿Sirve el robots.txt para desindexar? No de forma directa. La directiva Disallow previene el consumo de crawl budget, pero si la página ya posee un PageRank o historial indexado, permanecerá flotando en el índice.

¿Cuándo usar 410 en vez de 404? El 410 Gone debe implementarse ante la supresión intencionada y permanente de una página web, ya que envía una señal categórica al algoritmo de que el recurso ha desaparecido sin intención de retorno.

Anexo: Eliminar URLs de forma masiva con script en Google Search Console

Para la gestión integral y masiva de herramientas de retirada, es posible inyectar scripts de automatización desde las DevTools del navegador.

Metodología de ejecución:

- Navegar a la sección de Retiradas dentro de GSC.

- Desplegar la consola de herramientas de desarrollador (DevTools > Console).

- Insertar y configurar parámetros de lote basados en un script (ej. repositorios públicos o guías del ecosistema SEO).

- Ejecutar el automatismo.

Precaución: Este método técnico automatiza las retiradas de emergencia (limitadas a 6 meses). Resulta vital complementar estos lotes con señales técnicas nativas (410/noindex) y trabajar siempre con URLs canónicas exactas para prevenir desindexaciones colaterales.